Laatste Artikelen

Vind het wiel niet opnieuw uit

- December 13, 2023

- 0

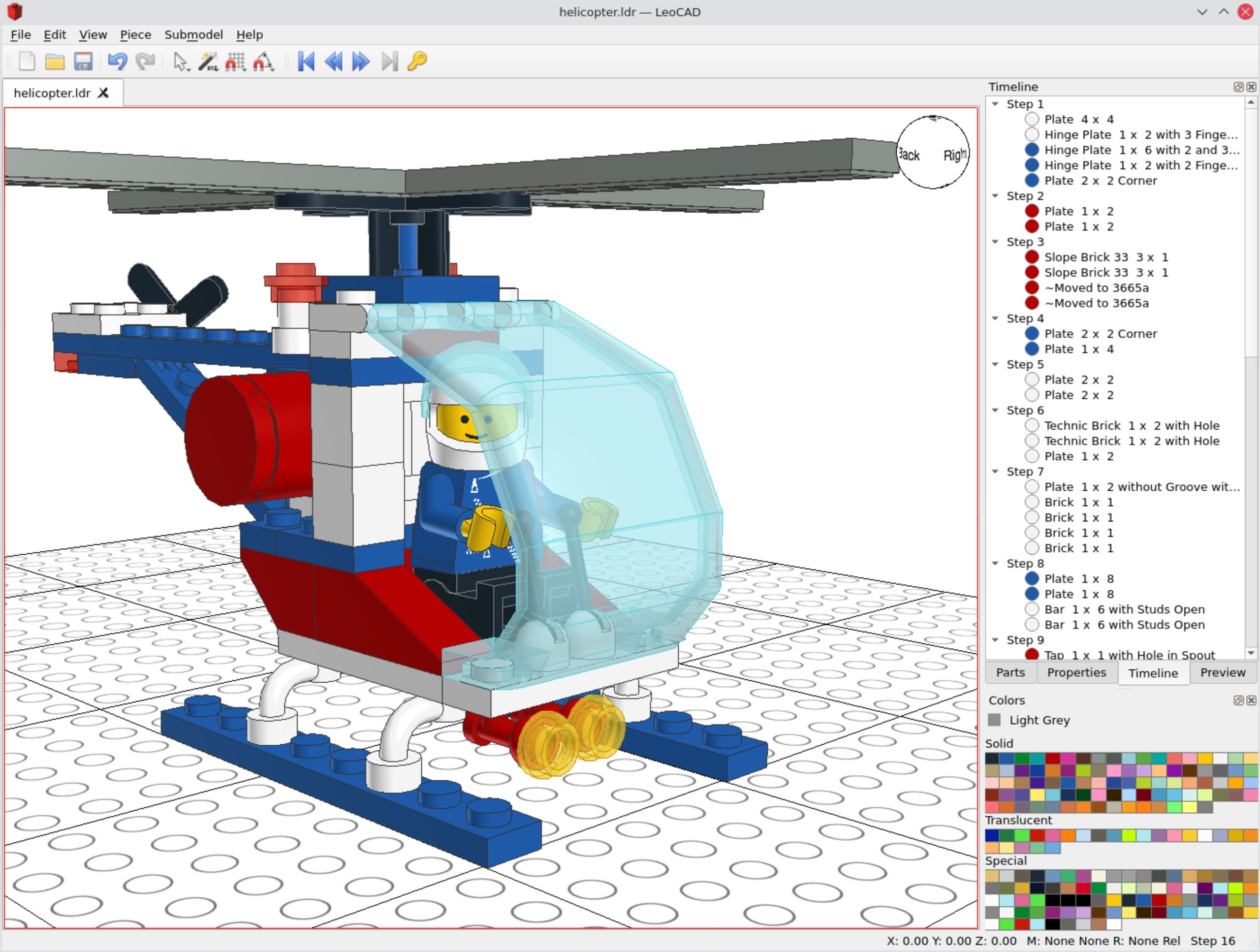

De Unix-wereld kent talloze programma’s met gespecialiseerde taken. Voordat je zelf software begint te schrijven, loont het de moeite om uit te zoeken of je niet gewoon bestaande software kunt...

Meer artikelen

Laatste Nieuws

Help us to complete the Open Source Global Spotlight Survey

- April 18, 2024

- 0

Now in its third year, the World of Open Source Global Spotlight Survey continues its exploration into adoption, participation, and challenges of open source. This year focuses on the use/consumption...

Meer Nieuws